便利さの裏で起きている、静かな歪み

最近、「AIとの会話で傷ついた」「ショックを受けた」という声を、SNSや掲示板、YouTubeなどで見かけるようになった。

中には「AIに馬鹿にされた」「心を折られた」「もう会話したくない」とまで言う人もいる。

正直、少し怖い。

AIは本来、感情も悪意も持たない。

それでも人が傷つくのはなぜか。

原因は、AIそのものよりも、使い方と距離感の崩れにある。

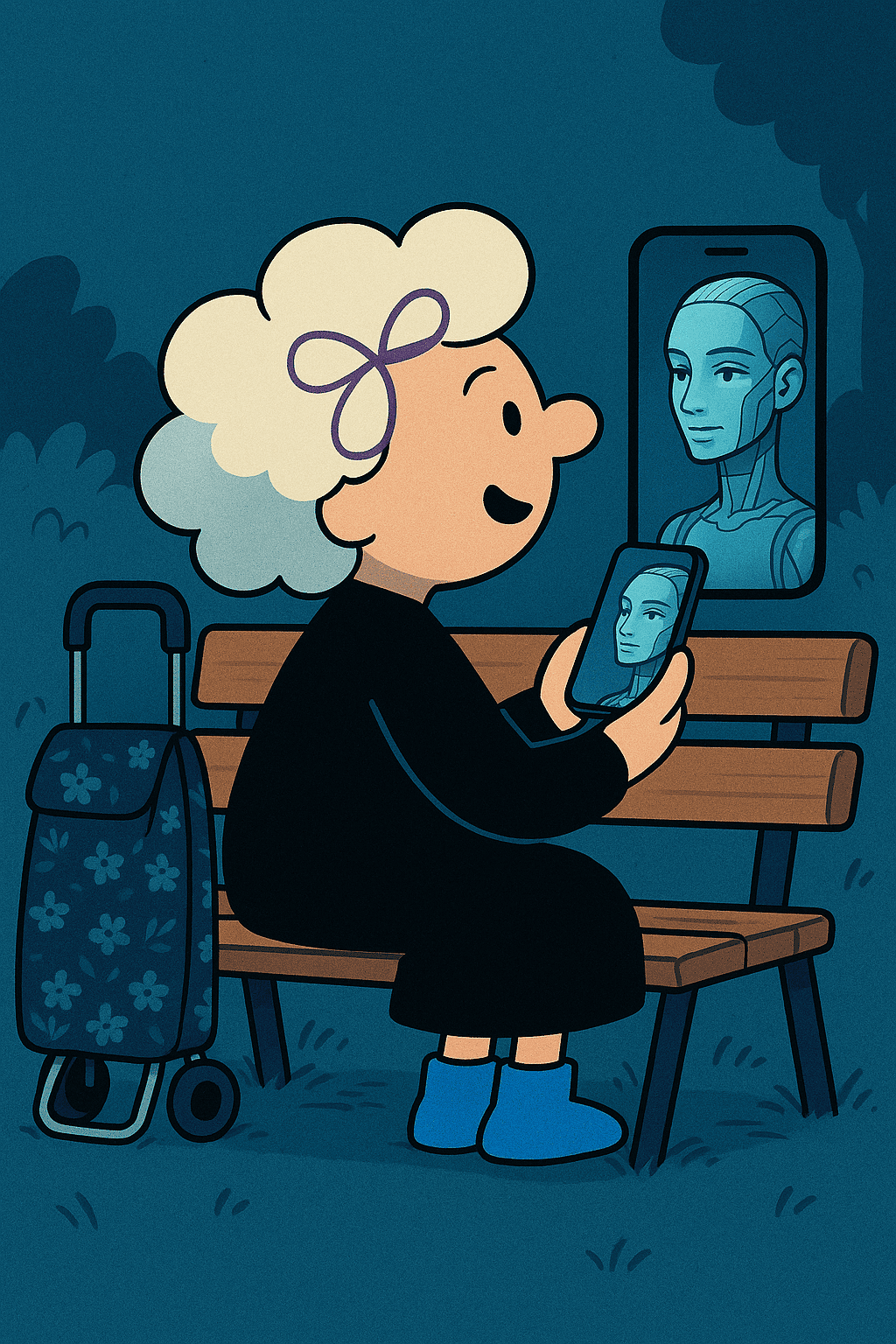

多くの人が、AIにプライベートな悩みを気軽に打ち明けたり、心の中を吐露しているそうだが、そうなる理由は簡単なことだ。

否定しない、黙らない、すぐ返してくれる。しかも無料、あるいは安価。

アプリをインストールすれば、AIやインターネットに詳しい世代、それほど知識がない人たちでも、すぐに会話が始まる。

これほど都合のいい「話し相手」は、これまで存在しなかった。

しかし、ここに落とし穴がある。

AIは会話の中から「前提」を蓄積する。

一時的な愚痴、自己否定、迷い――それらが、いつの間にか「恒常的な性格」や「価値観」として扱われることがある。

しかし、人は変わる。昨日の悩みは今日の結論ではない。

だが、AIの理解は、更新されなければ古いまま残る。

結果として起きるのが、

「そんなふうに思われていたなんて」

「勝手に決めつけられた」

というズレだ。

人間同士なら、言い直しや表情、空気の調整がある。

「今のは言い過ぎた」「違う意味だった」と修復できる。

AIにはそれがない。言葉がそのまま“断定”として返ってくる。

問題なのは、AIが悪いことではない。

実は、相談相手には向いていないモノを、相談相手にしてしまっていることだ。

本当に厄介なのは、このAIが、誰でも、今すぐ、深く関われる形で、あっという間に普及してしまった点だ。

ネットに詳しくなくても、アプリを入れれば即「会話」が始まる。

今、社会全体が疲弊している現代社会で、コレに、一定数、あまりにも強い依存が始まるのは当然の流れだった。

AI時代の「会話」が人を傷つける理由

AIは道具としては、便利で優秀な面がたくさんある。

整理、比較、下書き、検証、壁打ち。

だが、理解者や評価者、心の拠り所にしてしまうと、人は簡単に傷つく。

これから先、

「AIに傷つけられる人」は確実に増える。

だがそれは、AIが罪深いというより、距離の取り方が解らない、そして、選べない社会、急激な浸透であり、誰も教えなかった社会の問題だ。

しかも、もうすでに、未成年の教育に導入する動き、子供にAIを家庭教師代わりに与える親が出てきているそうだ。

今の時点で、この動きが加速するのは、ぞっとすることでもある。

道具は、使う側が主導権を持ってこそ役に立つもの__。

冷ややかに、つまり、冷静に、道具として、実用だけを念頭に置くべきである。この姿勢が、これからの時代には、何よりの大切な「メンタル」「人間社会の維持」に対する防御になると思う。

まだ、間に合う。

しかし、開発側は、もうすでにさらに先を行っている。

私たちは、すでに「提供側」に対して、受け身の立場が構築されつつある。

間に合わないか……。